Aujourd'hui, pour vous divertir, je souhaite vous parler des petites astuces qui me sont très utiles sur BOB4.

1) 1 seule liaison radio. Dans quasiment tous les drones que j'ai pu voir sur le web, on utilise plusieurs liaisons radios: 1 liaison "radiocommande" classique (en PCM ou PPM) pour envoyer les ordres manuels, 1 liaison bluetooth ou ZigBee pour les données, et une liaison vidéo pour la vidéo (bien sur). Pour faire un drone aussi petit et aussi léger que le mien, il faut faire simple: j'ai choisi d'utiliser 1 seule liaison radio pour toutes les utilisations: contrôle manuel (par la radiocommande), programmation (je n'arrive pas encore à programmer à distance, mais j'y travaille), envoi d'ordres et de paramètres au drone, retour d'information du drone vers l'écran de la radiocommande ou vers le PC. Ca a nécessité de refaire toute l'électronique de la radiocommande, mais je ne regrète pas mon choix.

2) La sécurité. Les modules bluetooth que j'utilise sont capable, en plus de la liaison série, de gérer des "lignes de contrôle" normalement attribuées au port série (RI, DTR, DCD, DSR). J'ai détourné l'utilisation de ces connexions pour plusieurs choses, et surtout pour la réalisation de la 'protection'. 1 ligne est dédiée à l'activation de la puissance des moteurs et des servos. J'ai 1 switch sur la radiocommande qui est directement relié à une des lignes de contrôle. Ca permet d'activer/désactiver la puissance, en hardware, grâce à un 74HCT08, quel que soit l'état de la carte mère. En cas de perte de liaison radio, cette ligne tombe automatiquement côté récepteur, ce qui met automatiquement le drone en sécurité. J'utilise une autre ligne de contrôle pour sélectionner le mode d'utilisation de la liaison série (grâce à un multiplexeur numérique 74HC157): programmation/débuggage, ou utilisation 'normale' de dialogue avec la carte mère.

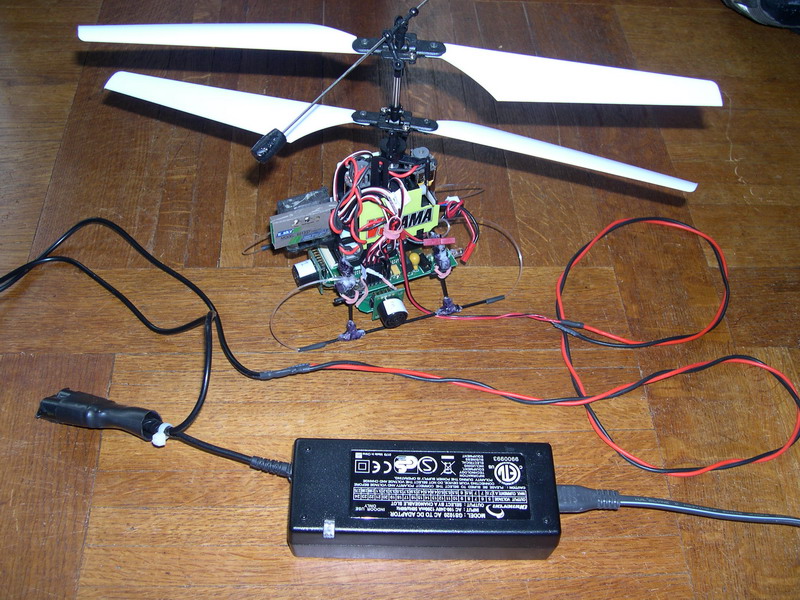

3) Une alimentation externe: J'utilise une alimentation externe. C'est super pour éviter de dépenser des batteries. Les batteries, ça se recharge en 1h, et ça se décharge en moins de 10 minutes de vol... Donc pas facile à gérer.

Je n'utilise pas les alimentations de labo, qui coutent trop cher, et qui sont trop encombrantes pour de telles puissance, mais une alimentation qui ressemblent à une alim de PC portable, capable de délivrer 50W sous 7 ou 8V. Attention, le cordon d'origine est trop rigide, et ça déstabilisait le petit drone. J'ai donc ajouté un cordon silicone (donc souple) d'1m, de section suffisante (0.75mm²).

Ensuite, il n'est en général pas recommandé d'alimenter avec ce genre d'alim à découpage des systèmes qui fonctionnent par impulsions et dépourvus de filtrage adapté, ce qui est le cas des contrôleur de moteurs de modélisme. Effectivement, j'ai pu tester, les oscillations sur l'alimentation sont énormes à pleine puissance. J'ai donc rajouté 2 gros condos de 4700µF adaptés à la tension (c'est plus facile d'avoir des hautes capacités pour des faibles tensions), et ça va beaucoup mieux.

http://www.electronique-diffusion.fr/product_info.php?products_id=878

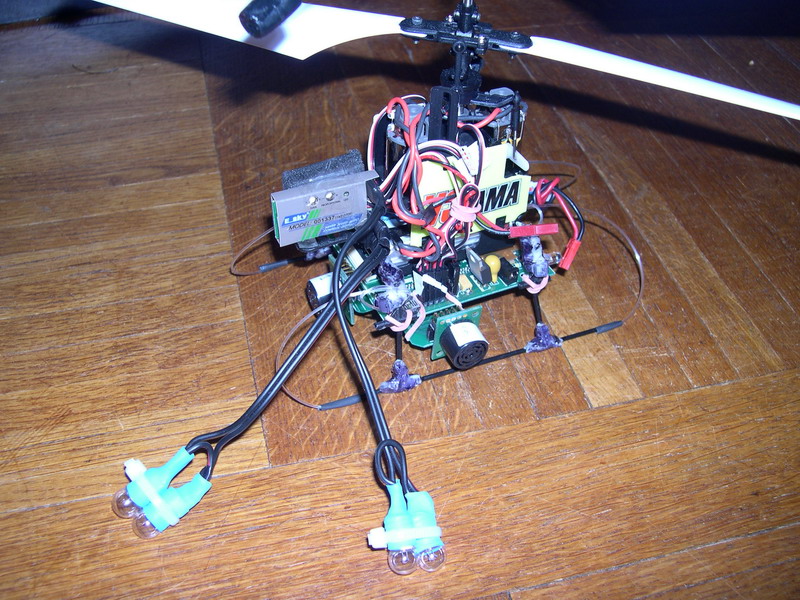

4) Des ampoules pour les tests: Pour les tests de l'électronique et du programme, mieux vaut éviter de faire tourner les moteurs. Ca les use, et surtout, c'est potentiellement dangereux s'ils ne sont pas maitrisés. Des pales, ça tourne vite... J'ai déjà détruit 2 pales en faisant un test sans prendre de précaution. Alors j'utilise tout simplement des ampoules 8V (ou plutôt 2 ampoules 4V en série pour chaque moteur) pour simuler les moteurs! C'est très simple, et très pratique. On visualise directement la puissance, pas besoin d'instrument de mesure!

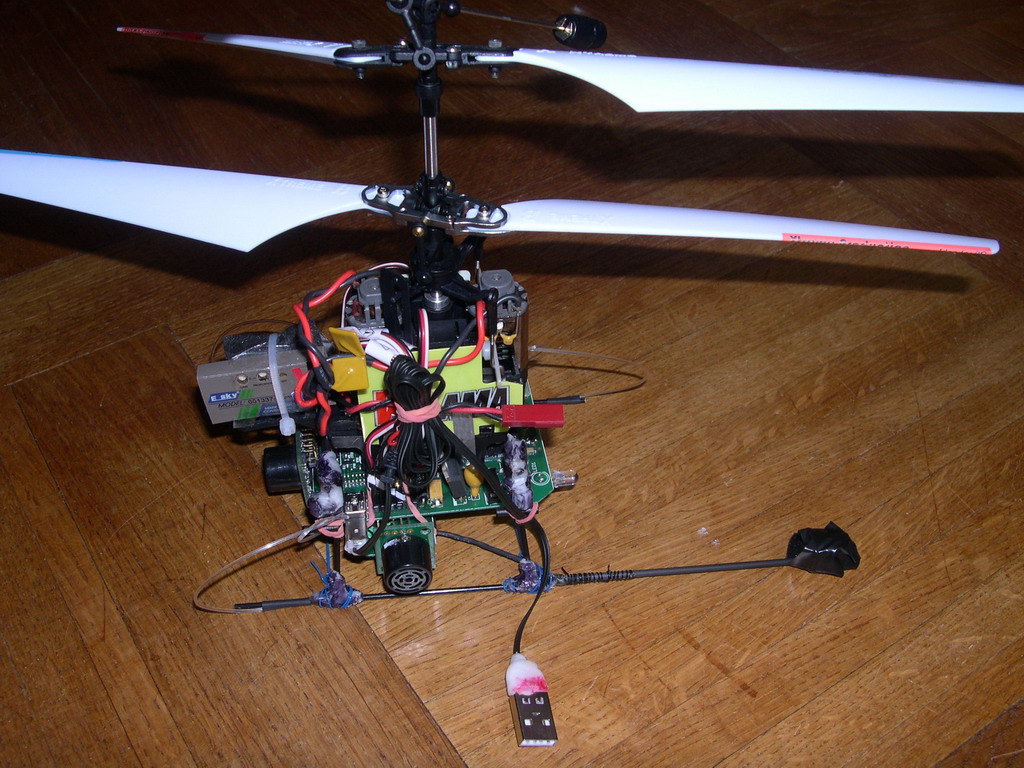

5) protections anti méli-mélo. J'ai placé des fils de nylons en bout des patins d'atterrissages, recourbés. Pourquoi? Parce que sans cet artifice, BOB4 pouvait se prendre les pieds dans les cordons, et là, c'est l'accident quasi assuré à cause du croche patte. Voir photo ci dessus.

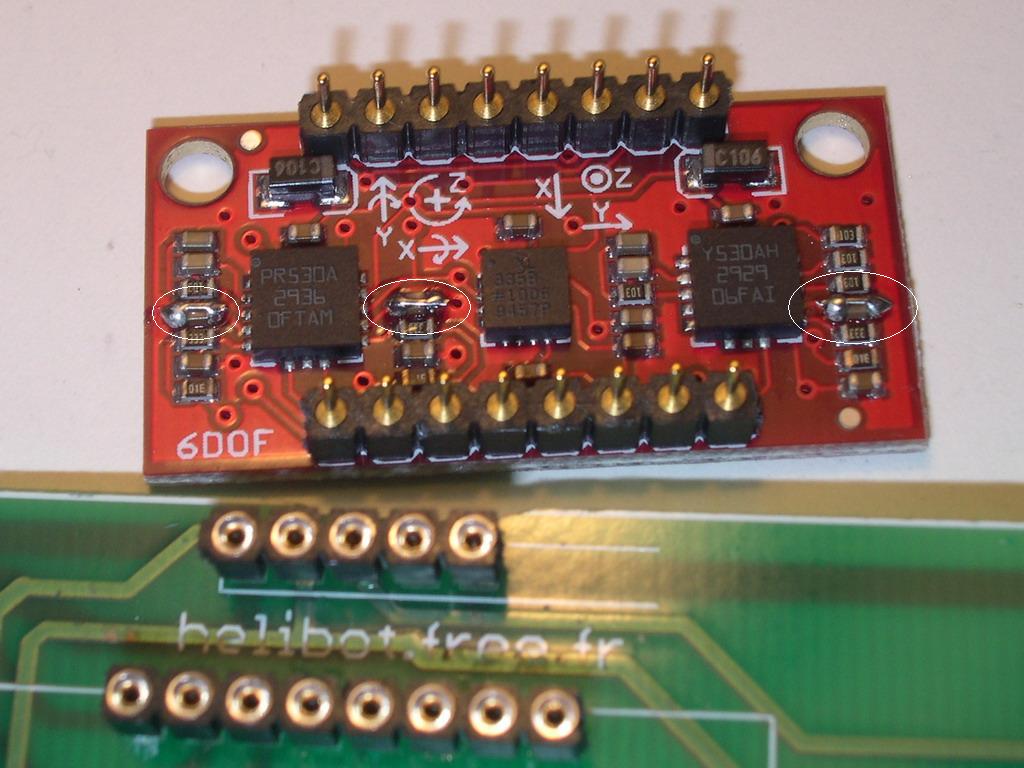

6) Désactivation du filtre passe haut des gyros: Sparkfun a fait une grosse connerie sur tous quasiment tous ses gyros ou centrales inertielles analogiques. Ils ont placé un filtre hardware passe haut qui est normalement "optionnel", et qui empêche d'intégrer (interpréter) convenablement les vitesses de rotation. Avec un filtre passe haut, les angles déduits sont forcément faux! Malgré les plaintes là dessus sur les forums, Sparkfun persiste a persisté dans l'erreur sur ses nouveaux produits. Ils promettent de corriger ça. La solution, c'est de désactiver ce filtre hardware. Contrairement à ce qui est indiqué sur les forums Sparkfun, pas besoin de désouder de composant, ce qui est TRES difficile avec cette taille de composants. J'ai simplement cour-circuité les 3 condos des 3 filtres passe haut. Et ça marche. Le résultat est bien meilleur avec cette bidouille. Attention, l'opération est assez délicate, car c'est tout petit.

7) fixation de l'électronique par élastiques: Les 2 platines électroniques sont fixées de manières souples sur le train d'atterrissage, grâce à des élastiques. C'est pratique et utile. C'est léger, plus léger que des vis, c'est souple, et donc ça permet d'encaisser les chocs plus facimenement. Les atterrissages forcés sont (et seront) nombreux. En plus, ça permet de filtrer (un peu) les oscillations pour la centrale inertielle.

C'est tout pour aujourd'hui, la suite au prochain numéro!

Leon.