Bonjour,

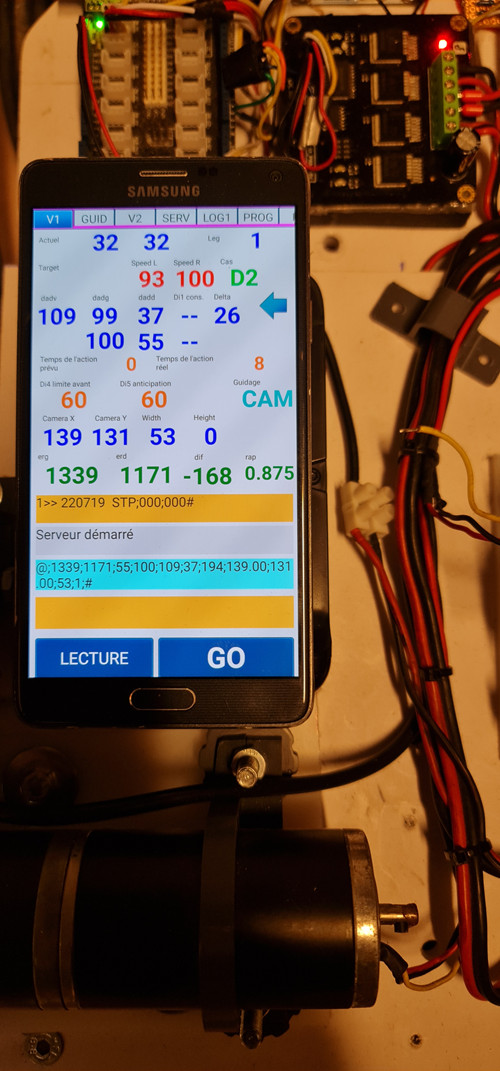

Je souhaiterais guider un robot bimoteur grâce à une camera AI Huskylens.

La cible se trouverait à 20 mètres devant le robot et celui-ci se dirige sur la cible.

C'est en intérieur ou en extérieur (éclairage)

J'ai fait différents essais notamment avec les Qrcodes mais dans ce cas la portée est limitée à 2/3 mètres.

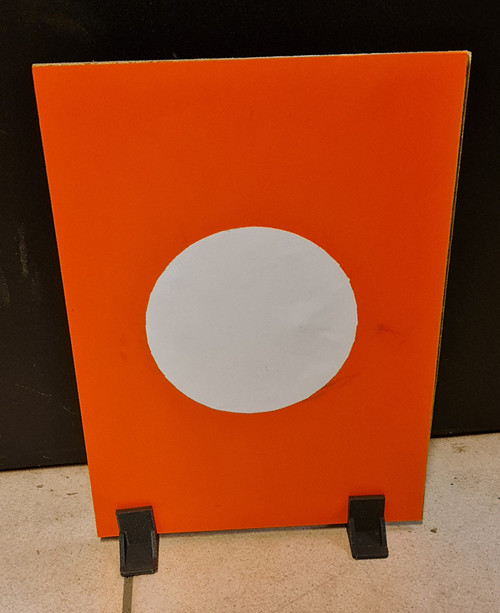

J'ai choisi d'utiliser le mode Object tracking : la première phase est l'apprentissage. On montre l'objet à la camera.

Ensuite dès que l'objet est reconnu dans le champ de vision, la camera envoie les coordonnées de l'objet sur l'image.

Ca fonctionne bien mais pour des petites distances de 5/6 mètres avec des cibles raisonnables de la taille d'une feuille A4.

Je voudrais mieux comprendre quels sont les différents paramètres qui permettent à l'AI de reconnaître l'objet.

- éclairage

- la couleur de l'objet

- la taille de la cible

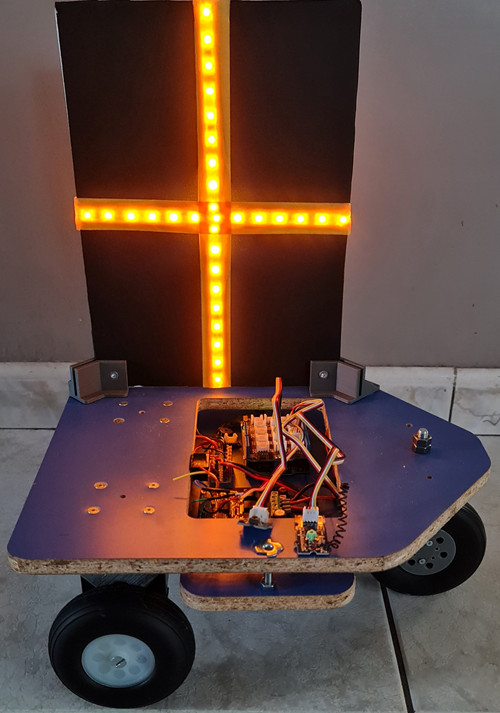

L'idée serait d'utiliser une cible lumineuse qui pourrait être visible même par faible luminosité.

Qu'en pensez-vous ?

Avez-vous déjà utilisé de type de camera dans ce contexte ?